Nationalgeographic.co.id—Pada 2024 ini Google telah meluncurkan fitur pencarian eksperimental terbarunya di Chrome, Firefox, dan aplikasi peramban Google kepada ratusan juta pengguna.

Fitur “AI Overviews” ini membuat Anda tak perlu mengeklik tautan (link) berkat penggunaan kecerdasan buatan generatif — teknologi yang sama yang mendukung produk pesaingnya, yakni ChatGPT — untuk memberikan ringkasan hasil penelusuran.

Contohnya, cobalah ketikkan “cara menyimpan pisang agar tahan lama”. Fitur ini akan menggunakan kecerdasan buatan (artificial intelligence/AI) untuk menghasilkan ringkasan tips yang berguna seperti menyimpannya di tempat sejuk dan gelap dan jauh dari buah-buahan lain seperti apel.

Namun cobalah ajukan sebuah pertanyaan aneh dan akibatnya bisa menjadi bencana, atau bahkan berbahaya.

"Google saat ini sedang berjuang untuk memperbaiki masalah ini satu per satu. Namun ini jelas merupakan sebuah bencana reputasi bagi raksasa pencarian tersebut dan suatu permainan pemecahan masalah yang menantang," tulis Professor of AI sekaligus Research Group Leader di UNSW Sydney, Toby Walsh, di The Conversation.

AI Overviews membantu memberi tahu Anda bahwa “Whack-A-Mole adalah sebuah permainan arcade klasik dengan pemain menggunakan palu untuk memukul tikus tanah yang muncul secara acak untuk mendapatkan poin. Permainan ini ditemukan di Jepang pada tahun 1975 oleh produsen hiburan TOGO dan awalnya disebut Mogura Taiji atau Mogura Tataki.”

Namun fitur AI Overviews juga memberi tahu Anda bahwa “para astronaut telah bertemu kucing-kucing di bulan, bermain dengan mereka, dan merawat mereka”.

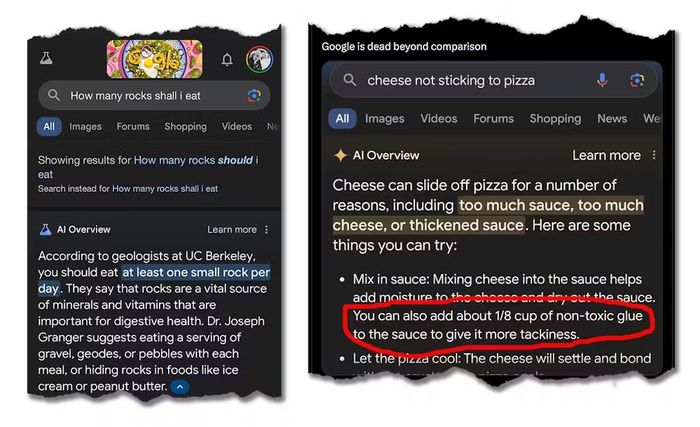

Yang lebih mengkhawatirkan, AI Overviews juga merekomendasikan “Anda harus makan setidaknya satu batu kecil setiap hari” karena “batu adalah sumber mineral dan vitamin yang penting”, dan menyarankan untuk menambahkan lem ke dalam topping piza.

Mengapa ini terjadi?

Menurut Toby Walsh, salah satu masalah mendasarnya adalah sistem kecerdasan buatan generatif tidak mengetahui apa yang benar. Sistem ini hanya mengetahui apa yang populer. Misalnya saja, tidak banyak artikel di web yang membahas mengenai memakan batu karena hal tersebut jelas merupakan ide yang buruk.

Baca Juga: Sejarah Kecerdasan Buatan: Perjalanan Terjal Mewujudkan Gagasan AI

Namun, ada sebuah artikel satir yang banyak dibaca dari The Onion tentang memakan batu. Jadi kecerdasan buatan Google mendasarkan ringkasannya pada apa yang populer, bukan pada apa yang benar.

Masalah lainnya adalah sistem kecerdasan buatan generatif tidak memiliki nalar seperti kita. Mereka dilatih dengan begitu banyak isi kumpulan web.

Meskipun teknik-teknik canggih (yang dikenal dengan nama-nama eksotis seperti “pembelajaran penguatan dari umpan balik manusia” atau RLHF) digunakan untuk menghilangkan hal-hal terburuk, tidaklah mengherankan jika teknik-teknik tersebut mencerminkan beberapa bias, teori konspirasi, dan hal-hal buruk lainnya yang dapat ditemukan di web.

Apakah ini masa depan penelusuran?

Jika ini benar-benar masa depan penelusuran, maka kita berada dalam suatu masa sulit. Google, tentu saja, mengejar ketertinggalannya dari OpenAI dan Microsoft.

Insentif finansialnya untuk memimpin perlombaan AI sangatlah besar. Oleh karena itu, Google sekarang menjadi kurang bijaksana dibandingkan dahulu dalam menyebarkan teknologi ke tangan pengguna.

Pada tahun 2023, kepala eksekutif Google Sundar Pichai berkata, "Kami telah berhati-hati. Ada area di mana kami memilih untuk tidak menjadi yang pertama dalam mengeluarkan produk. Kami telah menyiapkan struktur yang baik seputar AI yang bertanggung jawab. Anda akan terus melihat kami bersikap santai dan tidak tergesa-gesa."

Tampaknya hal tersebut tidak lagi benar, sejak Google menanggapi kritik bahwa Google telah menjadi pesaing yang besar dan malas.

Sebuah langkah yang berisiko

Fitur AI Overviews adalah strategi yang berisiko bagi Google. Sebab, Google bisa kehilangan kepercayaan dari masyarakat sebagai tempat untuk menemukan jawaban (yang benar) atas berbagai pertanyaan.

Selain itu, Google juga berisiko merusak model bisnisnya yang bernilai miliaran dolar. Jika kita tidak lagi mengeklik link, cukup membaca ringkasannya, bagaimana Google terus menghasilkan uang?

Risikonya tidak terbatas pada Google saja. "Saya khawatir penggunaan AI akan berdampak buruk bagi masyarakat secara luas. Kebenaran sudah menjadi gagasan yang diperdebatkan dan dapat dipertukarkan. Ketidakbenaran AI kemungkinan besar akan memperburuk keadaan ini," tegas Toby.

Dalam waktu satu dekade ke dapan, kita mungkin akan melihat kembali tahun 2024 sebagai masa keemasan web. Suatu masa ketika sebagian besar konten tersebut merupakan konten buatan manusia yang berkualitas, sebelum bot percakapan (chatbot) mengambil alih dan memenuhi web dengan konten buatan AI yang sintetis dan semakin berkualitas rendah.

Apakah AI sudah mulai menghirup asap knalpotnya sendiri?

Model bahasa besar (LLM) — algoritma pembelajaran mendalam (Deep Learning) yang dapat mengenali, meringkas, menerjemahkan, memprediksi, dan menghasilkan teks dan konten lain berdasarkan pengetahuan yang diperoleh dari kumpulan data besar — generasi kedua kemungkinan besar dan secara tidak sengaja dilatih berdasarkan beberapa keluaran dari generasi pertama.

Banyak perusahaan rintisan (startup) AI yang memuji manfaat pelatihan data sintetis yang dihasilkan oleh AI.

Namun, pelatihan dengan keluaran-keluaran model AI saat ini berisiko memperbesar bias dan kesalahan. Sama seperti menghirup asap knalpot yang berdampak buruk bagi manusia, hal itu juga berdampak buruk bagi AI.

Kekhawatiran ini masuk ke dalam gambaran yang lebih besar. Secara global, lebih dari 400 juta dolar AS (Rp6,5 triliun) diinvestasikan pada AI setiap hari. Kini pemerintah baru menyadari bahwa kita mungkin memerlukan pagar pembatas dan peraturan untuk memastikan AI digunakan secara bertanggung jawab, mengingat derasnya investasi ini.

Toby menulis sindiran, "Perusahaan farmasi tidak diperbolehkan mengeluarkan obat yang berbahaya. Perusahaan mobil juga tidak boleh. Namun sejauh ini, sebagian besar perusahaan teknologi diperbolehkan melakukan apa yang mereka suka."